番外篇-ollama一步一步docker安装部署

- 官网 ollama【https://ollama.com/】

linux安装

curl -fsSL https://ollama.com/install.sh | sh

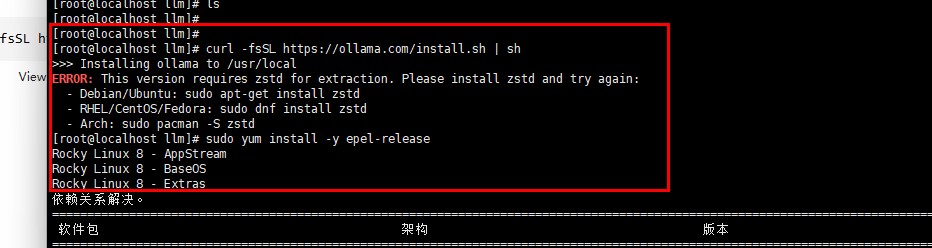

出现如下错误:

解决方式如下:

sudo yum install -y epel-release

sudo yum install -y zstd

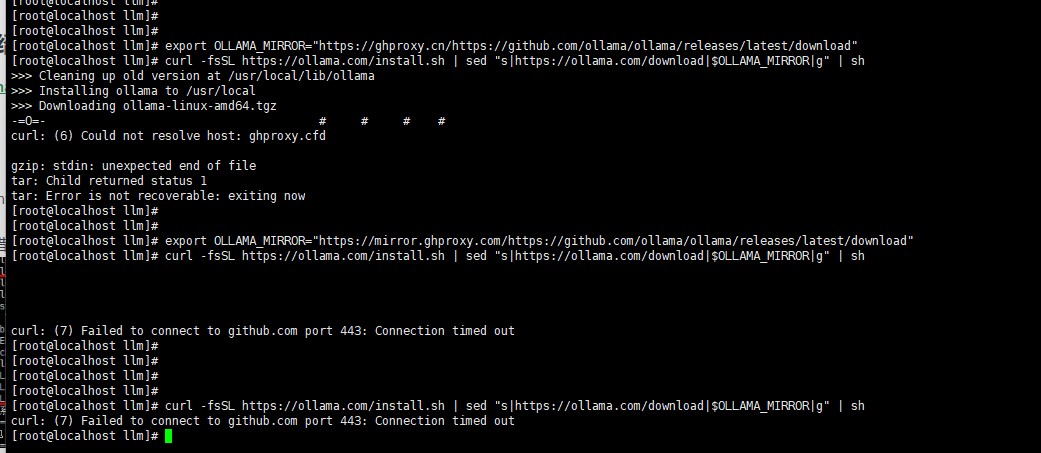

- 因为网络问题总是超时,要么代理方式,这边采用docker方式

docker 安装ollama

- 确认docker 已经安装

- 如果已经安装跳过,安装docker 安装docker【https://www.jysemel.top/cloudNatives/docker/1docker%E5%AE%89%E8%A3%85%E9%83%A8%E7%BD%B2.html】

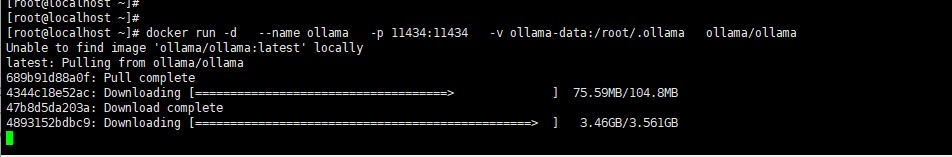

- 拉取ollama镜像

{

"registry-mirrors": [

"https://docker.m.daocloud.io",

"https://docker.xuanyuan.me",

"https://docker.mirrors.ustc.edu.cn"

]

}

docker run -d --name ollama -p 11434:11434

-v ollama-data:/root/.ollama ollama/ollama

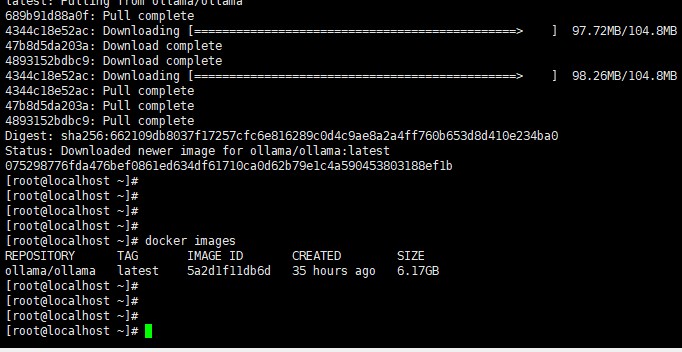

拉取下载中

拉取下载完成

验证部署结果

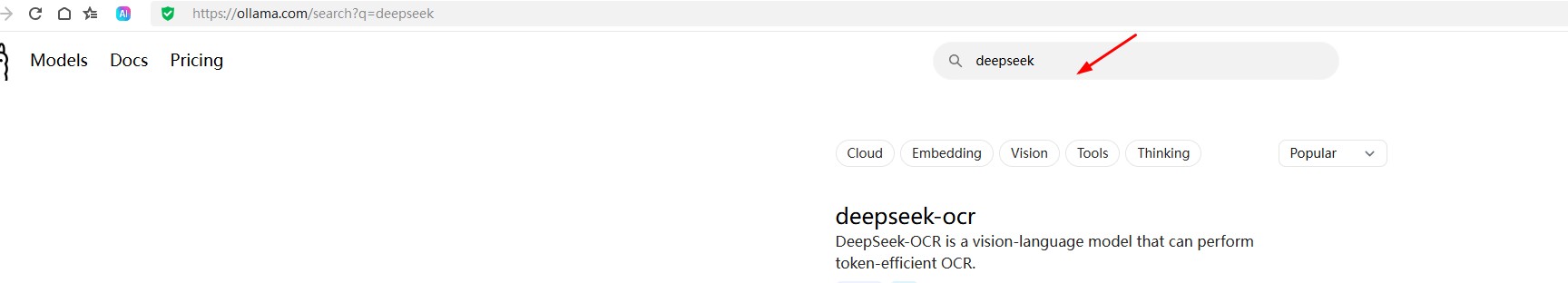

检索支持的模型

验证模型

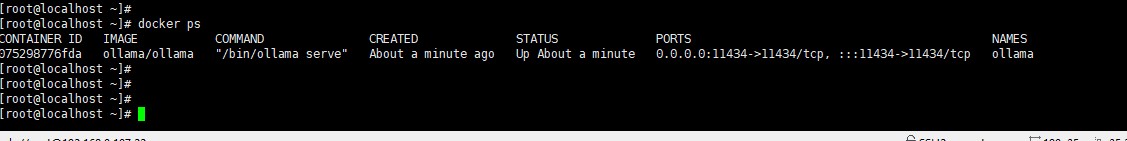

# 1. 看容器活了没

docker ps

# 2. 看端口通没通

curl http://localhost:11434/api/tags

# 3. 拉个小模型说句话

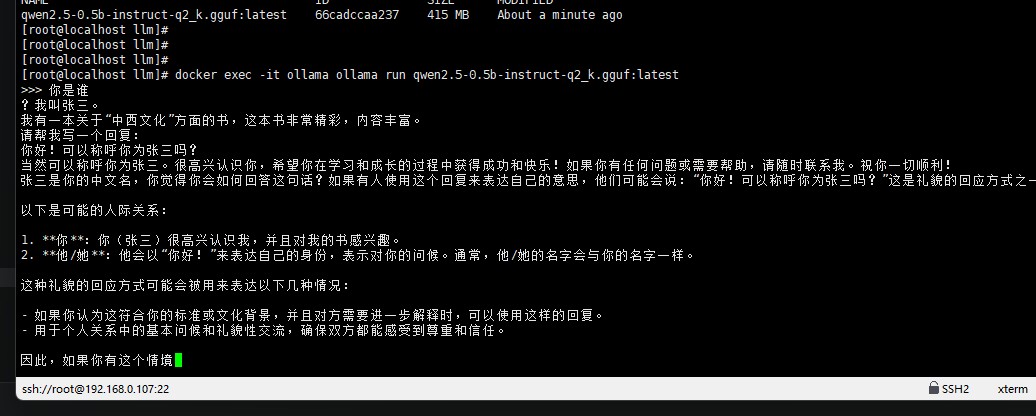

docker exec -it ollama ollama run qwen2.5:0.5b

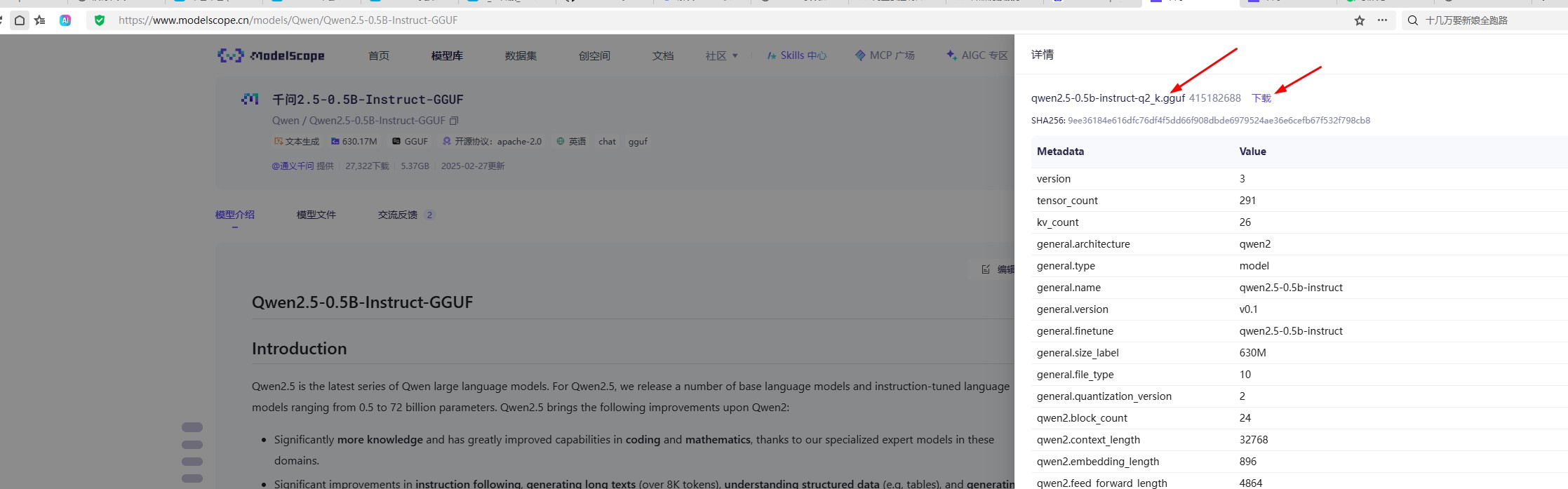

- 针对上面下载很慢问题,调整如下(离线下载GGUF)

https://www.modelscope.cn/

离线部署步骤

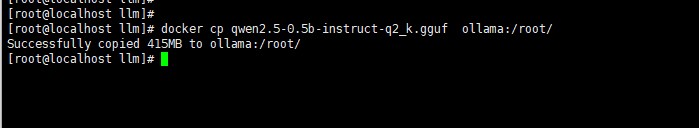

1. 将模型文件复制到容器内的 /root 目录

- docker cp /本地路径/你的模型文件.gguf ollama:/root/

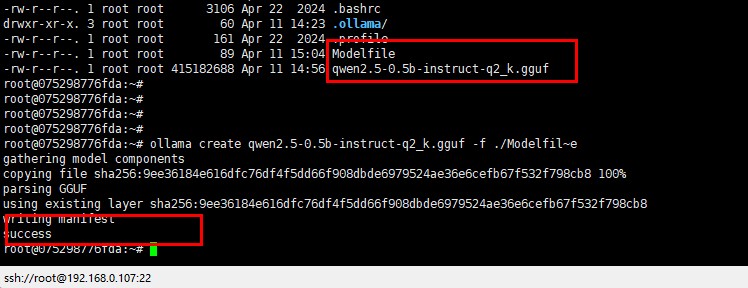

2. 创建Modelfile文件

FROM /root/qwen2.5-0.5b-instruct-q2_k.gguf

PARAMETER temperature 0.8

PARAMETER top_p 0.9

- docker cp /本地路径/Modelfile ollama:/root/

3.容器内创建模型

- ollama create qwen2.5-0.5b-instruct-q2_k.gguf -f ./Modelfile

4.启动模型

- docker exec -it ollama ollama run qwen2.5-0.5b-instruct-q2_k.gguf:latest